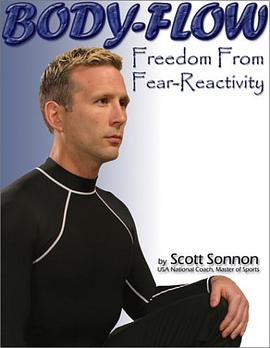

具体描述

作者简介

目录信息

读后感

评分

评分

评分

评分

用户评价

我必须赞扬这本书在文化多样性方面的细致考量。在如今全球化的背景下,很多亲子阅读材料往往聚焦于单一文化视角。然而,这本书提供了一个非常开阔的视野,它不遗余力地推荐了大量来自不同国家、描绘不同生活场景的优秀绘本。它不仅告诉我们“读什么”,更重要的是告诉我们“为什么读这些”。书中分析了如何通过阅读展现不同肤色、不同家庭结构的故事,来培养孩子的同理心和对差异的尊重。我按照书中的建议,特地去图书馆借了几本介绍不同国家节日的图画书,那效果简直是立竿见影,我的孩子开始对地图上的遥远国度产生好奇。这种跨文化的引入,让我们的阅读时间不再局限于我们的小家庭生活圈子,而是连接到了更广阔的世界。它让我意识到,一本优秀的图画书,其价值远超故事本身,它是通往理解世界的桥梁。

评分这本厚重的书简直是为我这种新手家长量身定做的“育儿圣经”!我记得当时刚拿到手,光是目录就让我感到无比的踏实。它不是那种空泛地告诉你“多读书对孩子好”的鸡汤文集,而是深入到每一个细节,从如何挑选适合不同年龄段的书籍,到朗读时的声调变化、面部表情管理,甚至连孩子坐立不安时该如何巧妙地引导他们重新集中注意力,都有详尽的步骤和生动的案例。最让我受益匪浅的是关于“互动式阅读”的章节,作者非常强调阅读不仅仅是单向的信息输出,而是一个双向的交流过程。我开始尝试着在读到关键情节时暂停下来,提问“你觉得接下来会发生什么?”或者“如果你是他,你会怎么做?”。奇妙的是,我发现孩子开始主动参与到故事的构建中,他的词汇量提升肉眼可见,更重要的是,他对书本的热情从“被动接受”变成了“主动探索”。这本书的排版也很人性化,很多关键点都有小贴士和引人深思的问答环节,让整个学习过程充满了乐趣而非压力。它真正教会了我如何将日常的亲子时光,打造成一场充满魔力的学习冒险。

评分坦白说,当我翻开这本书时,我原本期待的是一些“速成秘籍”或者“立刻见效的技巧”,结果它给我的却是更深层次的哲学思考。作者对于“阅读的本质”有着极其深刻的见解,她将亲子阅读提升到了“情感连结”和“建立安全感”的高度。书中花了很大篇幅探讨了为什么在信息碎片化时代,慢下来,用你真实的声音去诠释文字,对孩子的神经发展至关重要。我特别喜欢其中关于“沉默的力量”的论述。我们总担心孩子听不懂,总想填满每一个空隙,但作者指出,适当的停顿,让孩子有时间去消化画面和情感,比滔滔不绝的讲解更有穿透力。读到这部分时,我反思了自己以往急躁的阅读习惯,确实,我常常因为担心孩子分心而说得太快。这本书更像是一位经验丰富的老朋友,耐心地梳理着我的认知误区,引导我关注阅读过程中那些微妙的、非语言的信号。它没有给我一个固定的模板,而是提供了一套灵活的思维框架,让我能根据自己孩子的独特气质,去定制我们专属的阅读仪式。

评分这本书的结构设计非常巧妙,它像一个循序渐进的课程表,从最基础的“抱姿和眼神接触”开始,逐步深入到复杂的主题阅读策略。我注意到它对不同年龄段的侧重点把握得极其精准。比如,对于蹒跚学步的孩子,它强调的是重复、节奏和色彩辨识;而对于即将进入小学的孩子,它则侧重于如何通过故事来讨论复杂的社会情感,比如友谊中的背叛、面对失败的勇气。有一个章节专门讲解了如何处理“不喜欢的书”——当孩子总是要求读同一本“听起来很幼稚”的故事时,我们该如何应对。书中的建议不是生硬地拒绝,而是巧妙地利用重复的韵律来巩固孩子的语言基础,同时在重复中植入新的词汇或提问。这种“顺势而为”的智慧,在日常育儿中极其难得。阅读这本书的过程,与其说是学习阅读技巧,不如说是对如何高质量陪伴孩子进行了一次全面的“校准”。

评分这本书的实用性和可操作性,是我读过的所有育儿书中最高的。它没有太多理论性的术语堆砌,而是充满了大量“你可以马上尝试”的小练习。例如,它提供了一个“朗读疲劳自测表”,帮助父母识别自己是不是因为疲惫而无意识地降低了朗读的质量。更棒的是,它甚至讨论了“如何利用科技辅助而不是取代阅读”——如何选择那些真正有益的电子资源,而不是被无休止的动画分散注意力。我特别喜欢它关于“建立家庭阅读角”的章节,它不是要求你必须购置昂贵的家具,而是提供了一系列低成本、高效率的布局建议,比如利用光线、软垫和易于取放的收纳架,来营造一种“随时可以开始阅读”的氛围。这本书的价值不在于读完就束之高阁,而在于它成为了一个活的工具箱,每当我遇到新的育儿难题时,我都会重新翻开它,总能找到针对性的、充满人情味的解决方案。

评分 评分 评分 评分 评分相关图书

本站所有内容均为互联网搜索引擎提供的公开搜索信息,本站不存储任何数据与内容,任何内容与数据均与本站无关,如有需要请联系相关搜索引擎包括但不限于百度,google,bing,sogou 等

© 2026 qciss.net All Rights Reserved. 小哈图书下载中心 版权所有