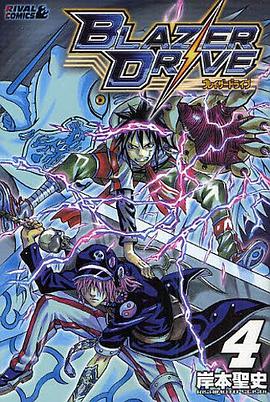

具体描述

作者简介

目录信息

读后感

评分

评分

评分

评分

用户评价

我对这本教材最关切的,是它在“矩阵运算加速”方面的论述深度。要知道,在那个硬件性能远不如现在的年代,MATLAB 5.3能够脱颖而出,其背后的底层优化策略和用户能用到的向量化技巧是核心竞争力。我希望能看到作者如何具体讲解,在那个特定版本下,如何有效避免显式的 `for` 循环,转而使用内置的矩阵函数来提升计算速度。如果书中能对内存管理机制,哪怕是那个版本相对原始的内存分配和释放逻辑有所涉及,那将是极大的加分项。我记得当时很多用户为了追求效率,会手动进行预分配,不知道这本书是否收录了这方面的“高级秘籍”。另外,对于当时MATLAB对外接口(如与C/Fortran的连接,即MEX文件调用)的介绍,也希望能有详尽且可操作的步骤指南,毕竟在资源有限的年代,调用外部库是扩展功能的常见手段。这本书若能成为那个时代高效编程的“葵花宝典”,其历史价值和技术参考价值便不言而喻了。

评分关于学习资源和配套支持的期望,这本近乎“古籍”的教程,其配套的电子资源(如光盘附带的M文件或数据文件)自然是难以获取的了。因此,我对书籍本身的内容自洽性要求更高。我特别想知道,书中所有示例代码是否都经过了严格的校对和测试,确保在MATLAB 5.3环境下能够百分之百无误地运行。在那个没有即时网络反馈的年代,教材的准确性就是一切。如果书中能够提供一套完整的“项目实战案例”,比如一个完整的、从数据采集到结果可视化的简单仿真项目,并且在每一步都清晰地标注出版本特定的函数调用和参数设置,那这本书就具备了极高的考古和学习价值。这种完整、自洽的项目叙事,能帮助读者建立起完整的知识框架,避免学完零散知识点后依然感到迷茫的困境。

评分作为一本特定版本(5.3)的教程,我非常好奇它对当时MATLAB新增的特定功能模块的覆盖程度。比如,相比于5.2或其他早期版本,5.3版本在图形化界面或特定工具箱(如Simulink或特定的控制系统工具箱)上是否有显著的增强或改动?如果作者能够详细对比这些新特性与旧版本的差异,并且通过具体的例子来演示如何利用这些新增功能解决问题,那么这本书的针对性就会非常强。很多老版本的教材常常是泛泛而谈,但在一个精确版本号下,读者需要的是“这个版本能做什么,别人做不到什么”。举例来说,针对当时主流的仪器控制协议支持情况,书中是否有专门的章节介绍如何通过串行或并行端口与外部硬件进行数据交换?这种与硬件交互的“实用性”,往往是区分一本普通参考书和一本真正“实战指南”的关键所在。希望这本书在工具箱的应用深度上能有所建树。

评分翻开目录时,我首先关注的是基础数学概念和编程逻辑的讲解方式。MATLAB的核心在于矩阵思维,对于一个初学者来说,如何用最直观的方式理解向量、矩阵的运算规则,并将其自然地转化为MATLAB代码,是学习曲线的第一道坎。我希望这本教程能采用“问题导向”的教学法,而不是枯燥的命令列表。比如,不是简单地介绍 `inv()` 函数,而是通过一个具体的线性方程组求解实例,展示矩阵求逆的必要性、局限性(比如奇异矩阵的处理)以及代码实现。此外,关于程序流程控制,例如条件判断和循环结构在该版本中的最佳实践是什么?尤其是在那个阶段,递归函数的效率考量和错误处理机制(如旧式的 `try-catch` 或其他错误捕获方法)的讲解,应该体现出鲜明的时代烙印。如果教程能深入浅出地阐述这些编程基础,而非仅仅停留在语法层面,它对打下坚实基础将大有裨益。

评分这本书的装帧设计相当朴实,封面配色稳重,透露着一股老派技术手册的严谨气息。初拿到手时,最先吸引我的是其厚实的纸张和清晰的字体排版,这对于长时间阅读技术书籍来说是个非常重要的加量。内容上,我期待能找到对当年MATLAB 5.3界面布局的详尽图解,尤其是对于那些初次接触那个时代软件环境的用户,如何快速定位工具箱、理解命令窗口和工作区的基本操作逻辑,这些基础环节的讲解是否足够细致入微。例如,关于M文件编辑器的新特性(相对于更早期的版本),或者那个版本中特定的数据类型处理方式,这些在现在版本中可能已经彻底革新但对理解历史脉络至关重要的地方,希望书中能给予足够的笔墨。此外,由于是“实用教程”,我更看重它是否能提供大量贴合当时工程或科研实际需求的案例,而不是停留在纯粹的语法罗列上,比如当时常见的信号处理流程搭建,或者基础数值优化问题的求解脚本示例,这些“实战”的份量,直接决定了这本书的实际价值和收藏意义。

评分 评分 评分 评分 评分相关图书

本站所有内容均为互联网搜索引擎提供的公开搜索信息,本站不存储任何数据与内容,任何内容与数据均与本站无关,如有需要请联系相关搜索引擎包括但不限于百度,google,bing,sogou 等

© 2026 qciss.net All Rights Reserved. 小哈图书下载中心 版权所有