具体描述

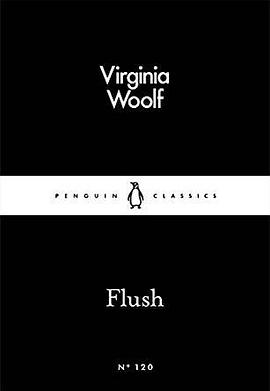

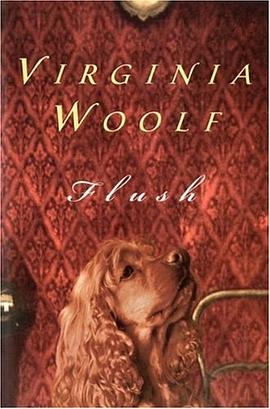

This story of Elizabeth Barrett Brownings cocker spaniel, Flush, enchants right from the opening pages. Although Flush has adventures of his own with bullying dogs, horrid maids, and robbers, he also provides the reader with a glimpse into Brownings life. Introduction by Trekkie Ritchie.

作者简介

二十世纪英国最杰出的作家,现代主义的代表人物,意识流小说技巧的开创者,代表作包括小说《达洛维夫人》、《到灯塔去》、《海浪》、《奥兰多》和散文《一间自己的屋子》等。《阿弗小传》是当年她最为畅销和受读者欢迎的作品。

目录信息

读后感

二十世纪的最后十年,由于女性主义批评的兴盛和后现代主义重审现代主义之潮流的泛起,弗吉尼亚•伍尔芙大概是世界范围内最受关注的经典作家。她的每部作品,甚至包括书信和日记,都成为评论家和研究者的精华文本,围绕它们衍生而出的论文和专著浩如烟海。当时还在学校读书的...

评分《阿弗小传》,弗吉尼亚•伍尔芙一改严肃的现代女权主义意识流写法,用狗狗的视角和感触去讲述自己一生陪伴主人——维多利亚时代女诗人勃朗宁夫人的道路。其中,有欢喜,有悲伤,有惊恐,有安详,而这一切的一切,都通过弗吉尼亚优美的文字展现出来,令人陶醉。 被誉为二十...

评分弗吉尼亚·伍尔芙的《阿弗小传》是本有趣的传记。传记的主人公阿弗不仅是一只狗,且并非伍尔芙自己的狗。而写别家宠物大多是借物喻人,就算真为宠物立传的,也多是记传者自己的观察感叹,换句话说,极少有把别人家的宠物当作一个独立的有思想有情感有内心独白的主角来写作的传...

评分先前看网页上的简介,加上收到书时看扉页,我才知道,对于这本书,我不算陌生,大学时在图书馆就有看过这本书,只是书的中文译名不一样。作为意识流派的大家,弗吉尼亚.伍尔芙用她独到老练的文笔为读者讲述了关于勃朗宁夫妇的爱情故事,只是,她是从勃朗宁夫人的爱犬Flush(阿...

评分弗吉尼亚·伍尔芙的《阿弗小传》是本有趣的传记。传记的主人公阿弗不仅是一只狗,且并非伍尔芙自己的狗。而写别家宠物大多是借物喻人,就算真为宠物立传的,也多是记传者自己的观察感叹,换句话说,极少有把别人家的宠物当作一个独立的有思想有情感有内心独白的主角来写作的传...

用户评价

这本书的语言风格也是我非常欣赏的一点。它没有华丽的辞藻堆砌,也没有故作高深的术语,而是用一种朴实却充满力量的文字,将故事娓娓道来。这种简洁而富有表现力的语言,反而更容易触动人心,让读者沉浸在故事的海洋中,而不会因为过度的修饰而感到疏离。

评分这本书的封面设计就足以让人驻足,深邃的蓝色背景,点缀着几抹若隐若现的银色纹理,仿佛预示着故事中将要揭开的某个秘密,或是隐藏在平静表面下的暗流涌动。我拿到这本书时,首先吸引我的就是这种低调而又极具质感的视觉呈现,它没有花哨的插图或醒目的标题,而是用一种内敛的方式,唤起了我对未知的好奇心。拿到手里,触感也是相当舒适,纸张的厚度和韧度都恰到好处,翻阅时有一种沉甸甸的满足感,这对于我这样一个喜欢实体书的读者来说,是至关重要的。

评分从第一页开始,我就被作者营造出的那种独特的氛围深深吸引住了。那种感觉难以言喻,既有某种难以摆脱的宿命感,又夹杂着一丝丝希望的微光。角色们的对话,没有刻意的雕琢,却句句戳心,仿佛能够穿透纸张,直接与读者的内心产生共鸣。我尤其喜欢作者对于环境的描写,那种细腻到仿佛触手可及的刻画,无论是晨曦中弥漫的薄雾,还是夜幕下寂静的街道,都让我身临其境,仿佛置身于故事发生的那个地方,感受着那里的一切。

评分故事的推进方式也相当巧妙,作者似乎很擅长运用“留白”,在关键的时刻戛然而止,留下足够的想象空间让读者去填补,而不是一股脑地将所有信息都倾倒出来。这种叙事手法,让我在阅读的过程中,始终保持着一种高度的专注和期待,不断地猜测接下来的发展,并且享受着这种猜测和推理的过程。每一次的转折,都来得自然而又出人意料,让我忍不住惊叹于作者的构思之精妙,仿佛在跟着一个高明的棋手走下一步棋。

评分我喜欢这本书给我的那种“欲罢不能”的感觉。即使在放下书本的时候,故事中的人物和情节也常常会在我的脑海中回荡。作者巧妙地在故事的结尾留下了一些开放性的结局,这让我对接下来的发展充满了遐想,并且迫不及待地想要知道更多。这不仅仅是一本书,更像是一扇门,通往一个充满无限可能的世界。

评分这本书给我带来的一个非常深刻的体验是,它让我开始重新审视一些生活中的常识和固有的观念。作者通过故事中的人物和情节,提出了一些非常发人深省的问题,这些问题并没有标准答案,而是鼓励读者去独立思考,去形成自己的见解。我发现自己在阅读过程中,思维变得更加活跃,开始尝试从不同的角度去看待同一件事情。

评分总的来说,这本书给我留下了极其深刻的印象。它不仅仅是一部引人入胜的故事,更是一次关于人性、关于生活、关于选择的深刻探讨。我迫不及待地想与更多的人分享我的阅读体验,并向所有热爱深度思考和精妙叙事的读者强烈推荐它。它绝对是一本能够让你在阅读后久久回味的佳作。

评分阅读这本书的过程,就像是在解开一个层层包裹的谜团,每一次的阅读都像是在剥开一层迷雾,然后发现新的线索,引出新的疑问。作者的叙事节奏掌握得非常好,既有让人屏息以待的紧张时刻,也有让人舒缓下来思考的空间。我发现自己常常会在阅读完一个章节后,停下来回味其中的细节,思考人物之间的关系,以及他们所处的境地。

评分我不得不提的是,书中对于人物内心的描摹,简直是入木三分。作者并没有简单地讲述他们的行为,而是深入到他们每一次决策背后的动机,甚至是那些连他们自己都未必能完全察觉的潜意识驱动。这种对人性的深度挖掘,让我对书中每一个角色都产生了复杂的情感,他们不再是简单的“好人”或“坏人”,而是充满矛盾、有着各自的挣扎和渴望的鲜活个体。

评分这本书的书写方式,让我感觉作者不仅仅是在讲故事,更像是在与读者进行一场深入的对话。每一次的阅读,都像是在与一位智者交流,他提出的观点和引发的思考,都让我受益匪浅。我发现自己在阅读过程中,不仅获得了阅读的乐趣,更重要的是,它在某种程度上改变了我看待世界的方式。

评分“Things are not simple but complex. If he bit Mr Browning he bit her too. Hatred is not hatred; hatred is also love.” 伍尔夫的共情能力和细腻程度已经超越了物种,她和一只鼻子湿漉漉的小狗一起呼吸。气味是世界存在的基础,Wimpole Street和Whitechaple/Shoreditch是两个世界,就像dull, damp, sunless, joyless, expensive, conventional England和Florence是两个世界,狗必须被拴上绳子的Regent Park和狗可以自由奔跑的Reading是两个世界。

评分狗角度的爱情 可爱的伍尔芙

评分皤然迟暮,他梦回西班牙荒野,耳边响起维纳斯的狩猎号角,眼前野兔脱逃。“Span, Span!”

评分“Things are not simple but complex. If he bit Mr Browning he bit her too. Hatred is not hatred; hatred is also love.” 伍尔夫的共情能力和细腻程度已经超越了物种,她和一只鼻子湿漉漉的小狗一起呼吸。气味是世界存在的基础,Wimpole Street和Whitechaple/Shoreditch是两个世界,就像dull, damp, sunless, joyless, expensive, conventional England和Florence是两个世界,狗必须被拴上绳子的Regent Park和狗可以自由奔跑的Reading是两个世界。

评分经考证(见common reader),此书女主是有原型的,名叫Elizabeth Barrett Browning,终年卧病在床。她的狗也确实叫Flush,spaniel(西班牙猎犬)。

相关图书

本站所有内容均为互联网搜索引擎提供的公开搜索信息,本站不存储任何数据与内容,任何内容与数据均与本站无关,如有需要请联系相关搜索引擎包括但不限于百度,google,bing,sogou 等

© 2026 qciss.net All Rights Reserved. 小哈图书下载中心 版权所有